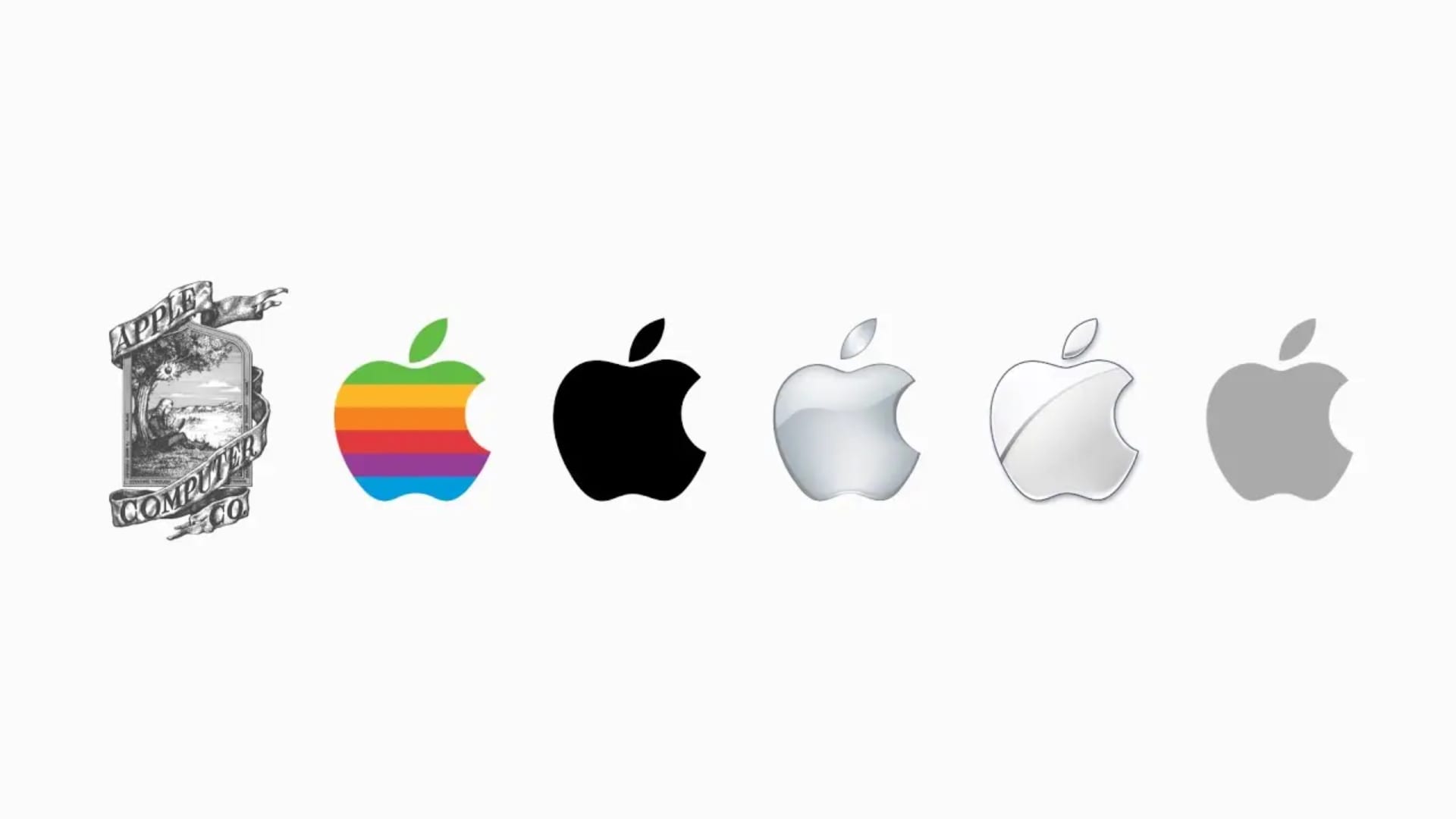

Le 10 juin 2024, Apple a fait quelque chose d'inhabituel. Quelque chose de presque contre-nature pour la marque.Source : WWDC24Elle a annoncé un produit qui n'était pas prêt.Pas par incompétence technologique. Pas parce que l'équipe dormait pendant que OpenAI réinventait l'IA. Mais parce que les marchés paniquaient. Parce que les actionnaires regardaient l'explosion de ChatGPT et se demandaient à voix haute si Apple avait raté le tournant le plus important de la décennie. Alors Apple a fait ce que Jobs n'aurait jamais fait : elle a montré ce qu'elle allait livrer, pas ce qu'elle pouvait livrer.C'est ça, la vraie rupture avec l'ADN Apple. Pas le partenariat avec Google.Parce que l'ADN d'Apple, c'est précisément ça : utiliser la technologie d'un partenaire externe le temps de construire la sienne en mieux. Intel avant Apple Silicon. Google Maps avant Maps. The Weather Channel avant l'app Météo. Gemini s'inscrit dans cette tradition longue et assumée, Apple externalise le temps de construire. La vraie erreur, elle est à la WWDC 2024. Apple a cédé à la pression de Wall Street et promis avant d'être prête. Et cette promesse allait leur coûter dix-huit mois de retards, un recours collectif, et une restructuration interne douloureuse.Voici ce qui s'est réellement passé en coulisses.L'illusion de l'été 2024Sur le papier, Apple frappait fort. Le nouveau Siri devait gérer les hésitations, les phrases incomplètes, les changements d'idée à la volée. Mieux encore, il devait enchaîner les requêtes : demandez le score d'un match, puis dites "Ajoute le prochain à mon calendrier". Siri comprend. Enfin.Source : WWDC24Apple montrait aussi un Siri conscient de ce qui s'affiche à l'écran, une intégration multimodale pure : texte, voix, vision. Ajouter une adresse reçue par SMS à un contact, envoyer une photo en disant "Envoie-la à Paul". Un saut technologique réel par rapport à l'ancien Siri basé sur des scripts rigides.Puis le vernis a craqué.Quelques jours après la WWDC, Apple confirme que le nouveau Siri ne sera pas prêt pour iOS 18.0. Il arrivera "plus tard" avec iOS 18.1. À l'automne 2024, iOS 18.1 sort. Apple Intelligence est là, résumés, génération de texte, outils d'écriture. Mais le cerveau de Siri ? Absent. Nouveau communiqué : rendez-vous au printemps 2025 avec iOS 18.4.Printemps 2025. L'espoir renaît. Mark Gurman lâche la bombe : nouveau retard, direction iOS 18.5.... et iOS 18.5 sort. Siri LLM est officiellement repoussé à l'année suivante.Le bilan est humiliant : des tests indépendants publiés en janvier 2025 montrent que Siri répond incorrectement à 66 % des questions factuelles basiques sur le Super Bowl, là où ChatGPT répondait correctement à 100 % d'entre elles. En interne, l'équipe IA d'Apple est surnommée "AIMLess" (sans but). Craig Federighi voit les taux d'erreur de la version interne atteindre 33 %, inacceptable pour un déploiement grand public. En décembre 2025, Apple règle un recours collectif intenté par des utilisateurs ayant acheté des appareils sur la foi de fonctionnalités jamais livrées.Le mur : une erreur d'architecture et un problème de RAMLe problème était double.D'abord, le logiciel. Depuis 2011, Siri est un assemblage de scripts, de règles rigides, de commandes figées. C'est l'antithèse absolue d'un LLM moderne. L'architecture même de Siri n'était pas seulement en retard, elle était fondamentalement incompatible avec la nouvelle ère de l'IA. Craig Federighi l'a reconnu publiquement : Apple disposait de deux versions de l'architecture IA pour Siri. La version 1, démontrée à la WWDC. La version 2, vers laquelle l'équipe a dû migrer pour atteindre le niveau de qualité attendu. Cette migration a nécessité de raser le bâtiment pour reconstruire les fondations.Greg Joswiak, VP marketing d'Apple, a confirmé qu'ils ont réalisé qu'ils ne pouvaient pas livrer un produit avec un tel taux d'erreur sans décevoir profondément leurs clients. La démo de la WWDC 2024 n'était pas du demoware, c'était un logiciel fonctionnel, mais l'architecture sous-jacente n'était tout simplement pas prête pour le grand public.Ensuite, le matériel. L'IA on-device a un coût dramatique : la mémoire unifiée. Faire tourner des modèles de 3 milliards de paramètres en local exige une bande passante mémoire colossale. L'avarice historique d'Apple sur la RAM se paie cash aujourd'hui. La véritable fluidité de cette promesse d'IA locale exigera des machines équipées de puces comme le M5 Pro avec un minimum de 24 Go de RAM. C'est le nouveau ticket d'entrée de la décennie.Le pacte : 12 janvier 2026Face à l'hémorragie de talents, Meta débauchant des ingénieurs IA clés avec des packages estimés à plusieurs dizaines, voire centaines, de millions de dollars, Apple prend une décision radicale. John Giannandrea, qui supervisait Siri depuis 2018, est écarté. Mike Rockwell prend la relève, directement sous Craig Federighi. La recherche, c'est fini. Place à l'exécution produit.Et l'exécution passe par une décision que beaucoup ont lue comme un aveu de faiblesse, à tort.Le 12 janvier 2026, Apple et Google publient un communiqué conjoint :"Apple et Google ont conclu une collaboration pluriannuelle dans le cadre de laquelle la prochaine génération d'Apple Foundation Models sera basée sur les modèles Gemini et la technologie cloud de Google."Un milliard de dollars par an. C'est le prix à payer pour une version white-label de Gemini personnalisée, environ 1,2 trillion de paramètres, contre 150 milliards pour les modèles actuels d'Apple Intelligence. Certains y voient une ironie. C'est surtout une stratégie qu'Apple a déjà jouée plusieurs fois : acheter du temps et des capacités pendant que le produit maison mûrit.Pourquoi Google plutôt qu'OpenAI ou Anthropic ? Apple a testé les deux. Gemini l'a emporté sur trois points : performance brute, prix compétitif, et infrastructure cloud mature basée sur des TPU optimisés. Le fait que Google verse déjà 20 milliards de dollars par an à Apple pour être le moteur de recherche par défaut sur iOS a aussi facilité les négociations.L'architecture hybride : le compromis (presque) parfaitAttention, Gemini ne remplace pas Siri. L'architecture est bien plus subtile.Niveau 1 — On-Device (Apple Foundation Models)Ces modèles compacts (3 milliards de paramètres) tournent directement sur le Neural Engine des puces A17 Pro, M1 et supérieures. Ils gèrent la compréhension des requêtes simples, l'analyse du contexte personnel (messages, calendrier, photos), la reconnaissance vocale, et la conscience visuelle on-screen. Apple revendique jusqu'à 70 % d'efficacité en plus par rapport à des architectures cloud pures.Niveau 2 — Private Cloud Compute (PCC)Quand la complexité dépasse les capacités locales, la requête remonte au PCC. C'est ici que Gemini entre en jeu, mais sur les serveurs d'Apple, pas sur Google Cloud. Des serveurs Apple Silicon, un OS dérivé d'iOS, une connexion TLS 1.3 avec attestation cryptographique. La requête est chiffrée de bout en bout, dépouillée de tous les identifiants personnels (Apple ID, IP, métadonnées) avant traitement. Les données sont effacées immédiatement après. Le hash cryptographique du système est publié publiquement pour audit indépendant.La formulation du communiqué officiel est clé : les AFM "seront basés sur Gemini", pas "remplacés par" Gemini. Apple utilise Gemini pour entraîner et enrichir ses propres modèles, pas en appel API direct.Source : Apple Developer websiteLa mort de l'interface utilisateurVoilà la partie que tout le monde sous-estime.Source : WWDC24Le nouveau Siri repose sur AppIntents 2.0, un framework qui permet aux développeurs d'exposer les capacités de leurs apps de manière atomique. Siri peut composer dynamiquement ces capacités : chercher des trajets, comparer les options, sélectionner la meilleure, lancer la réservation, sans jamais ouvrir l'application.Pensez-y une seconde. Vous passez des heures sur Figma. Vous cherchez l'alignement parfait, le minimalisme irréprochable, la hiérarchie typographique idéale. Pour quoi ? Pour une interface que Siri contourne entièrement.Avec Siri devenu orchestrateur, l'application devient fantôme. Le futur développeur iOS ne code plus une destination visuelle. Il code une API pour une intelligence artificielle. Le moteur de Siri, basé sur une technique appelée Tree of Thoughts, où plusieurs plans sont générés et évalués en parallèle, analyse, planifie et exécute en arrière-plan, avec un taux d'erreur interne annoncé à moins de 10 %.C'est un séisme pour l'industrie. Pas spectaculaire. Mais silencieux.Le calendrier : tout mise sur iOS 27Le vrai séisme arrive à l'automne. En interne, on l'appelle Campos. Siri devient chatbot à part entière : interface conversationnelle complète (voix + texte), génération d'images, assistance au code, analyse de fichiers, intégration profonde dans toutes les apps Apple. C'est la transformation que la marque promettait depuis 2024.Mais pour faire tourner cette itération avancée, connue en interne comme Apple Foundation Models v11, Apple négocie l'accès direct aux TPU de Google Cloud. Mark Gurman a confirmé que les deux entreprises sont en pourparlers avancés pour héberger cette prochaine génération directement sur les serveurs Google. Sundar Pichai lui-même, lors du Q4 2025 Alphabet earnings call, a décrit Google comme le "preferred cloud provider" d'Apple.Source : Google Next Cloud 2026C'est là que le discours d'Apple va trembler. Qu'est-ce que le privacy-first quand le cœur de votre IA tourne sur les serveurs de la régie publicitaire la plus puissante du monde ? Les données seront anonymisées, chiffrées, mais la question soulevée par les experts n'est plus "où vont les données". C'est ce qu'ils appellent la "perte de souveraineté décisionnelle" : Apple délègue la logique de traitement centrale à une infrastructure qu'elle ne contrôle pas.Le dévoilement public est attendu à la WWDC26 de juin, avec une sortie complète en septembre aux côtés des nouveaux iPhone.Ce qui vient aprèsLa suite est prévisible, et c'est presque rassurant. Apple investit dans des modèles propriétaires à environ 1 trillion de paramètres, prévus pour 2027. Le schéma est exactement le même qu'avec Maps en 2012 ou Apple Silicon remplaçant Intel : externaliser le temps de construire, puis reprendre la main quand le produit maison est prêt. Gemini est un pont, pas une destination.Ce qui est moins prévisible, c'est iOS 27 et le projet Campos. Parce que si pour iOS 26 Apple tient encore sa promesse de privacy, les modèles tournent sur son infrastructure, pas sur Google Cloud, la phase suivante pose une question que la marque n'a jamais eu à affronter aussi frontalement : qu'est-ce que le privacy-first quand l'inférence tourne sur les TPU de Google ?Là, il ne s'agit plus d'une stratégie temporaire assumée. Il s'agit d'expliquer publiquement, à la WWDC26, pourquoi confier le raisonnement central de Siri à la régie publicitaire la plus puissante du monde est compatible avec quinze ans de discours sur la vie privée.Les défis techniques restent nombreux, latence, hallucinations, complexité d'intégration. Mais si Apple parvient à tenir ses promesses, Siri pourrait enfin devenir l'assistant conversationnel que la marque promet depuis quinze ans. La question demeure, les utilisateurs, frustrés par des années de retards, donneront-ils à Apple une dernière chance ? La réponse arrivera dans quelques mois, quand Siri entamera sa dernière danse.

← Retour

Siri et sa dernière danse

Apple, champion de la vie privée, confie le cœur de Siri à Google. Retour sur deux ans de retards, de chantier interne et d'un deal qui change tout.